导语:可以确定的是,随着科技的进步,中国GPU算力行业一定要、也一定会摆脱被“卡脖子”的问题,让中国的AI企业用上中国的GPU,打赢这场算力之战。

近日,英伟达(NASDAQ:NVDA)在美国加州总部举办了面向软件开发者的年度技术峰会GTC。在会上,英伟达创始人黄仁勋披露了最新人工智能相关的软硬件技术,并在演说中将“AI的iPhone时刻”这句话重复强调了三遍。

事实上,英伟达与AI可谓是缘分不浅,截至目前,英伟达的GPU芯片正在为全球绝大多数的人工智能系统提供最基础的算力支持,而ChatGPT母公司OpenAI,便是凭借着10000片英伟达的GPU芯片,成功训练出了GPT-3大语言模型,震惊了全世界。

那么,提供了全球高端人工智能大半算力的英伟达CEO黄仁勋,为何在此次大会中将ChatGPT带来的变化称为“人工智能的iPhone时刻”?在“人工智能的iPhone时刻”背后,又是哪些基础硬件设施与相关的企业支撑着AI行业不断前行呢?

本文将以英伟达发布会为切入点,介绍国内GPU行业相关企业的发展现状,进而讲述为何算力缺乏的原因,以期为读者展现GPU行业的现状与未来发展。

火种初现的中国厂商

作为全球算力硬件当之无愧的龙头公司,英伟达每年的GTC大会都吸引着众多尖端科技工作者的目光,尤其是在2023这个ChatGPT的出圈元年,作为人工智能硬件的主要提供商,英伟达GTC的曝光量更是得到了显著的增加。

而在此次大会中,英伟达展示了其针对训练、推理、云服务等多维度的ChatGPT领域布局。

在AI训练领域,英伟达助力算力持续提升,赋能大模型突破。

基于GPU并行计算的特性以及英伟达在AI领域的前瞻布局,英伟达在AI训练领域拥有绝对优势,同时十分重视人工智能赛道,不断提升其人工智能硬件的计算能力。

并且,随着GPT大模型对于算力需求的提升,全球科技巨头均已开始或即将搭载英伟达的H100产品:Meta已在内部为团队部署了基于H100的Grand Teton AI超级计算机;OpenAI将在其Azure超级计算机上使用H100来为其持续的AI研究提供动力。

图源:英伟达公司官网

而在此次GTC 2023上,基于Hopper架构及其内置Transformer Engine,英伟达H100针对生成式AI、大型语言模型(LLM)和推荐系统的开发、训练和部署都进行了优化,利用FP8精度在LLM上提供较上一代A100更快的训练及推理速度,助力简化AI开发。

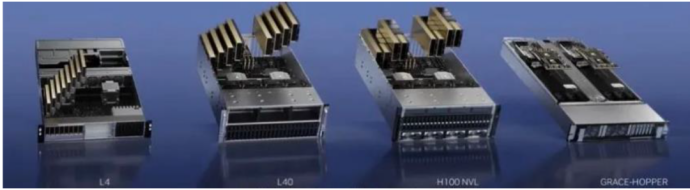

图源:英伟达公司官网,中金公司研究部

而在AI推理领域,AI视频、图像生成、大型语言模型部署及推荐系统也在加速部署。

在今年的GTC 2023中,英伟达推出了全新的GPU推理平台:基于加速AI视频、图像生成、大型语言模型部署和推荐系统,形成了4种配置、1个体系架构和1个软件栈的产品体系。

图源:英伟达公司官网,中金公司研究部

其中H100 NVL GPU受到了市场较为广泛的关注:英伟达在GTC 2023公开表示,该产品将配备双GPU NVLink,或将实现比现用A100快10倍的速度,可处理拥有1750亿参数的GPT-3大模型,并支持商用PCIe服务器扩展,适用于训练大型语言模型。

黄仁勋称,相较于目前唯一可以实时处理ChatGPT的HGX A100,一台搭载四对H100和双NVLink的标准服务器能将速度提升10倍,并且还可以将大语言模型的处理成本降低一个数量级。黄仁勋也将NVIDIA DGX H100称作全球客户构建AI基础设施的蓝图。

黄仁勋也表示,ChatGPT仅仅是人工智能第一个出圈的应用,也只是一个起点。在人工智能浪潮来临之时,全球范围内必将出现一批进军人工智能大模型硬件的企业。但英伟达在短期内拥有绝对的技术优势,未来也将持续发力。

毫无疑问,英伟达发布的最新硬件对于人工智能企业来说,是解决算力问题的最大福音,但对于中国企业来说,这却并非是一则喜讯。

2022年8月,美国监管机构以国家安全为由,对NVIDIA A100、H100两款GPU实施禁令,不得销售给中国企业,意在通过“卡脖子”的方法来降低国内AI模型的传输速度,拖延中国人工智能发展。

从长远来看,未来大模型的研发和部署是必然趋势,而每个大模型训练和部署的背后,都有几万个 GPU 芯片在支持。因此,未来随着这方面的研发和应用的普及,通用 GPU 市场需求将会迎来爆发式增长。