苹果WWDC全球开发者大会正式开幕。首场Keynote演讲上,苹果公司发布首款空间计算头显 Apple Vision Pro,iOS 17、macOS 14,以及 15 英寸的 MacBook Air、搭载最新M2 Ultra芯片的 Mac Studio和Mac Pro。

作为外界期待已久的新产品,苹果Vision Pro头显引发关注,官方称为“空间计算机(spatial computer)”,机身包含 12 个摄像头、5个传感器、6个麦克风、两块4K的Micro OLED显示屏,两颗芯片M2和新的R1、一个数字表冠,而显示屏中包含2300万像素和用于视力矫正的蔡司镜头。此外,该头显采用世界上第一个空间操作系统VisionOS,有专门的应用商店。

值得一提的是,苹果官网称,“Rose”R1处理器是专为Apple Vision Pro耳机设计的新芯片。那么,苹果首次公布的R1芯片,核心作用是什么?都有哪些新特性?

Apple R1芯片作用是什么?

Apple R1 处理器是专为混合现实耳机设计的芯片,例如新的Vision Pro。 而 R1 芯片不单独为耳机供电、运行,而是与苹果ARM架构的Apple M2芯片(为最新MacBook Air的同款处理器)一起运行。

其中,Apple M2芯片的任务是执行任务、瞬时交互、运行计算,使用户可以通过头显设备访问应用;而R1处理器属于低功耗芯片,负责定位、协同、视觉图像处理或传输等功能。

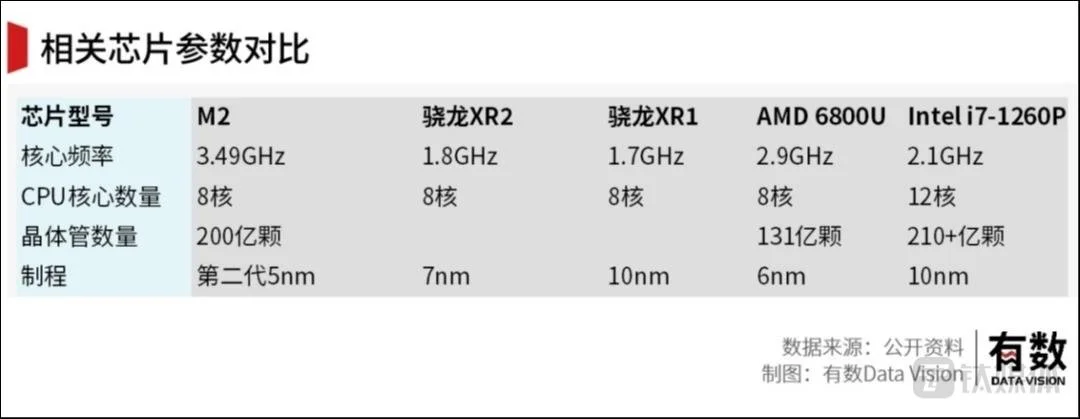

苹果M2芯片基于ARM架构,釆用台积电5nm工艺,包含200亿个晶体管,此前更多应用在13寸 MacBook Pro 、13寸和15寸MacBook Air (M2 芯片机型)当中。

而苹果发布的最新M2 Ultra,采用第二代5nm工艺制造,用UltraFusion 技术连接两个 M2 Max 芯片的Die裸片,产生1340亿个晶体管,CPU比M1 Ultra快20%,192GB内存容量比M1 Ultra提升50%,内存带宽是M2 Max的两倍,视频处理速度最高可提升50%,GPU性能提升高达30%,搭载至Mac Studio 以及 Mac Pro当中。

新的Vision Pro内置的另一款自研R1芯片,据苹果官网显示,全新的R1芯片处理来自12个摄像头、5个传感器和6个麦克风的输入,以确保内容实时呈现在用户眼前,R1芯片能在12毫秒内将新图像传输到显示屏中,比眨眼快8倍。

对于苹果来说尽快完成这些过程非常重要,因为这将有助于减少消费者“眩晕”的可能性。如果人眼在戴着耳机四处走动时能检测到延迟,可能会开始感到眩晕和恶心,而Apple R1芯片就是防止这种情况的发生。

9to5Mac作者钱斯·米勒(Chance Miller)在发布会后体验了苹果Vision Pro,他发现戴上30分钟内没有任何眩晕的感觉。他引述苹果公司称,两个4K显示屏组合和极低的延迟,是防止人们在佩戴Vision Pro时感觉眩晕的重要因素。

R1 内置蓝牙,或与AirTag同款

尽管苹果官方今天没有公布R1芯片的更多细节,但钛媒体App查询到,苹果AirTag定位器内置的核心传输和定位芯片也命名为R1,支持蓝牙功能,不过官方没有对外透露过这款芯片信息。

因此,鉴于苹果芯片线的命名规则、R1的功能相同等,有理由相信苹果Vision Pro搭载的R1芯片,或与苹果AirTag同款,也可能是AirTag R1芯片的改进版,以更好的传输和定位。这是苹果首次公布新的芯片产品线。

综合外媒报道,R1芯片基于ARM架构,属M系列运动协处理器改进版,同时也是低功耗芯片,与iPhone 11新机内置的U1 超宽带技术组合,可以使得 iOS 设备无缝配对,并允许它检测 AirTag 的远近位置。另外,R1还支持利用传感器反馈数据,内置“惯性测量单元”(IMU),支持“到达角”(AoA) 和“出发角”(AoD) 等功能。

根据钛媒体App看到的一份苹果Vision Pro 头显设备拆解的供应商信息和BOM清单,整个R1处理器是由苹果设计的,与M2单价相差一倍,因此推测 R1 芯片或采用成熟工艺节点。钛媒体App还查询到,目前给AirTag制造 R1 芯片的供应商是Nordic北欧半导体。